避難用簡易保護帽 でるキャップ for kids ブルー(子供用) DCFK-BU-01(代引不可)

(税込) 送料込み

商品の説明

商品情報

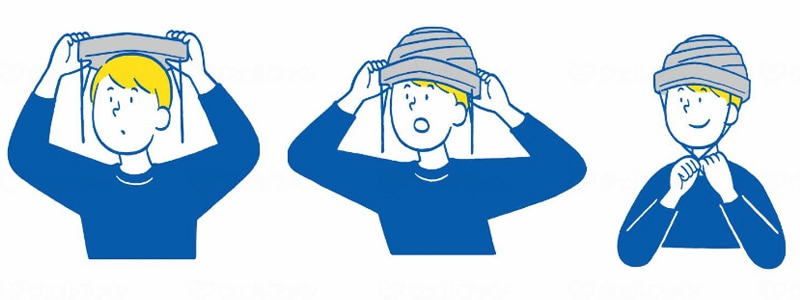

【商品名】 避難用簡易保護帽 でるキャップ for kids ブルー(子供用) DCFK-BU-01 【ジャンル・特徴】 頭でのせて3秒装着。いざという時の簡易保護帽(子供用) [ DCFK-BU-01 ]

6174円避難用簡易保護帽 でるキャップ for kids ブルー(子供用) DCFK-BU-01(代引不可)キッチン、日用品、文具防災、防犯、セーフティ避難用簡易保護帽 でるキャップ for kids イエロー(子供用) DCFK-YE-01でるキャップ for kids ブルー DCFK-BU-01 タイカ

でるキャップ for kids ブルー DCFK-BU-01 タイカ

避難用簡易保護帽 でるキャップ for kids イエロー(子供用) DCFK-YE-01

でるキャップ for kids DCFKシリーズ タイカ 保護具 【通販モノタロウ】

でるキャップ for kids DCFKシリーズ タイカ 保護具 【通販モノタロウ】

でるキャップ for kids DCFKシリーズ タイカ 保護具 【通販モノタロウ】

でるキャップ for kids DCFKシリーズ タイカ 保護具 【通販モノタロウ】

介護用品】避難用簡易保護帽 でるキャップ DERUCAP コンパクトタイプ 1

SAIBOU PARK|でるキャップ for kids 【ブルー】 タイカ 避難用簡易保護帽

避難用簡易保護帽 でるキャップ for kids イエロー(子供用) DCFK-YE-01

避難用簡易保護帽 でるキャップ レギュラータイプ(10枚入り)|防災

楽天市場】【 でるキャップ 避難用簡易保護帽 コンパクトタイプ(1枚入

グラっときたら! コンパクトタイプ タイカ 避難用 簡易保護帽 軽量

避難用簡易保護帽 でるキャップ for kids レッド(子供用) DCFK-RD-01

でるキャップ コンパクトタイプ 防災頭巾 防災ずきん 防災キャップ

SAIBOU PARK|でるキャップ for kids 【レッド】 タイカ 避難用簡易保護帽

でるキャップ for kids ブルー DCFK-BU-01 タイカ

でるキャップ for kids ブルー DCFK-BU-01 タイカ

楽天市場】【 でるキャップ 避難用簡易保護帽 コンパクトタイプ(1枚入

避難用簡易保護帽 でるキャップ for kids ブルー(子供用) DCFK-BU-01

でるキャップ for kids ブルー DCFK-BU-01 タイカ

でるキャップ コンパクト 避難用簡易保護帽 防災グッズ 防災ヘルメット

Amazon.co.jp: タイカ 防災頭巾 でるキャップ for kids 頭囲50~54㎝用

でるキャップ for kids ブルー DCFK-BU-01 タイカ

避難用簡易保護帽 でるキャップ for kids レッド(子供用) DCFK-RD-01

避難用簡易保護帽 でるキャップ for kids イエロー(子供用) DCFK-YE-01

でるキャップ for kids DCFKシリーズ タイカ 保護具 【通販モノタロウ】

アルファプラエイド でるキャップ コンパクト│防災用品・防災グッズ

Amazon.co.jp: タイカ 防災頭巾 でるキャップ for kids 頭囲50~54㎝用

でるキャップ コンパクト 避難用簡易保護帽 防災グッズ 防災ヘルメット

でるキャップ 防災頭巾

SAIBOU PARK|でるキャップ for kids 【ブルー】 タイカ 避難用簡易保護帽

Amazon.co.jp: タイカ 防災頭巾 でるキャップ コンパクトタイプ 1枚

でるキャップ for kids ブルー DCFK-BU-01 タイカ

避難用簡易保護帽 でるキャップ for kids イエロー(子供用) DCFK-YE-01

販売終了】避難用簡易保護帽 でるキャップ | 朝日新聞モール

αPLA アルファプラ|でるキャップ for kids(防災キャップ)

でるキャップ for kids ブルー DCFK-BU-01 タイカ

介護用品】避難用簡易保護帽 でるキャップ DERUCAP コンパクトタイプ 1

楽天市場】【 でるキャップ 避難用簡易保護帽 コンパクトタイプ(1枚入

商品の情報

メルカリ安心への取り組み

お金は事務局に支払われ、評価後に振り込まれます

出品者

スピード発送

この出品者は平均24時間以内に発送しています