下田エコテック SE-336SA-ZDBI ステンレス製蓋付

(税込) 送料込み

商品の説明

商品情報

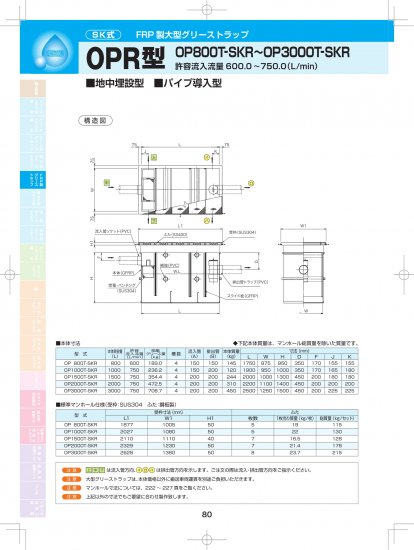

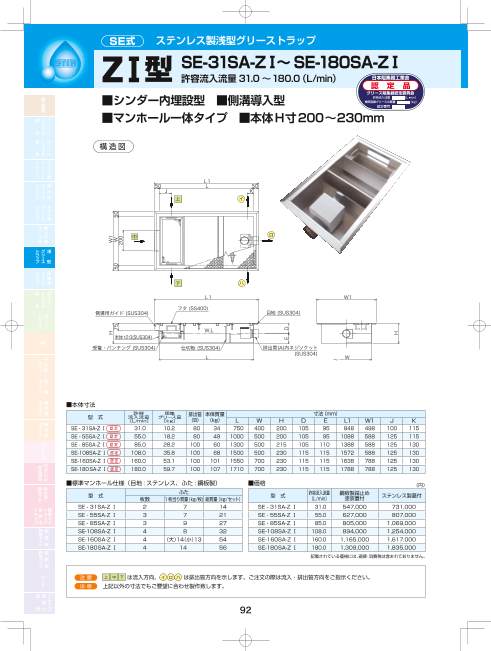

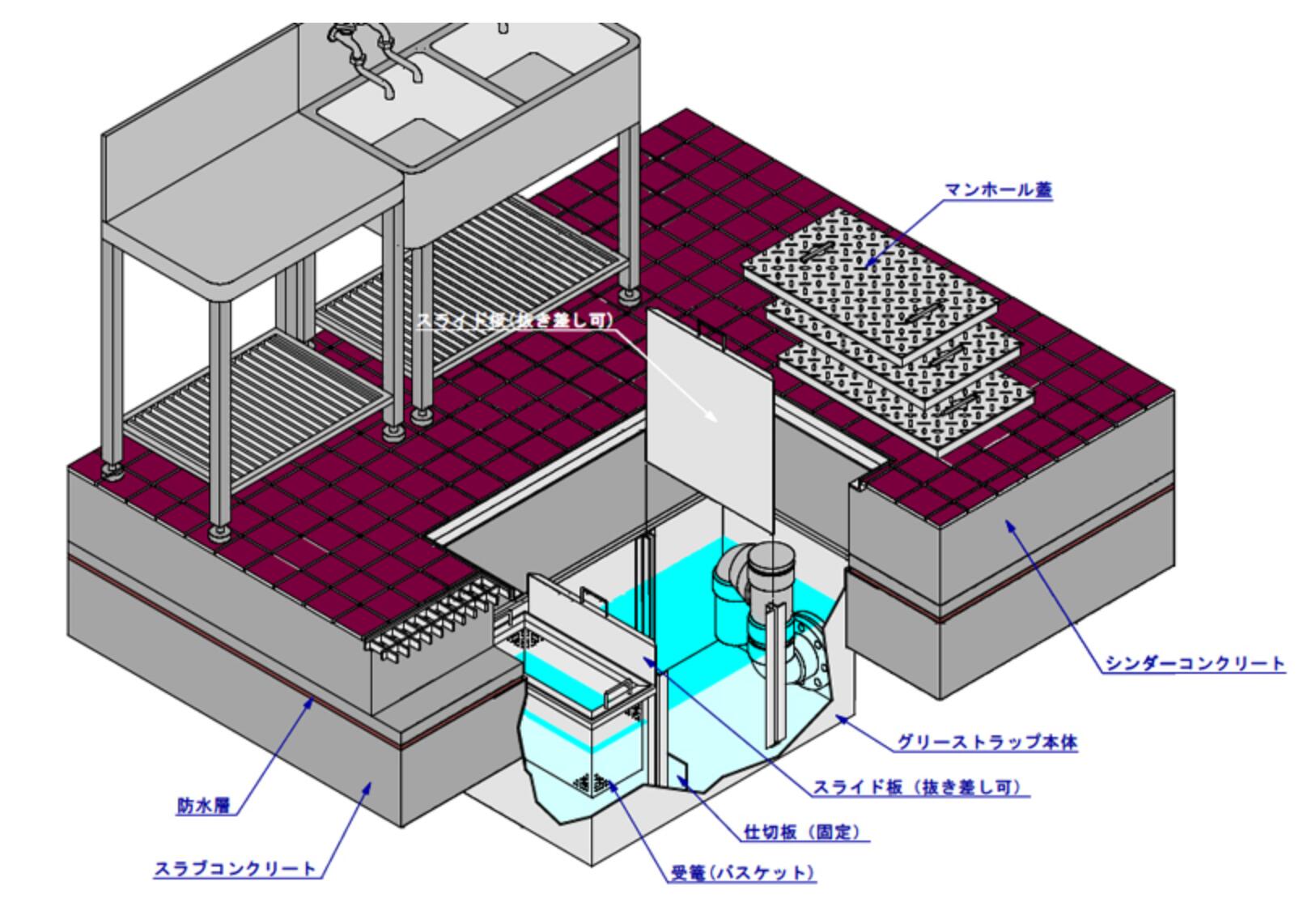

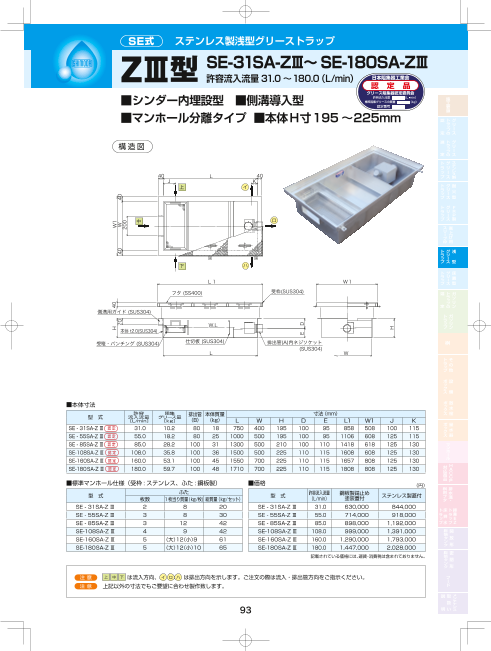

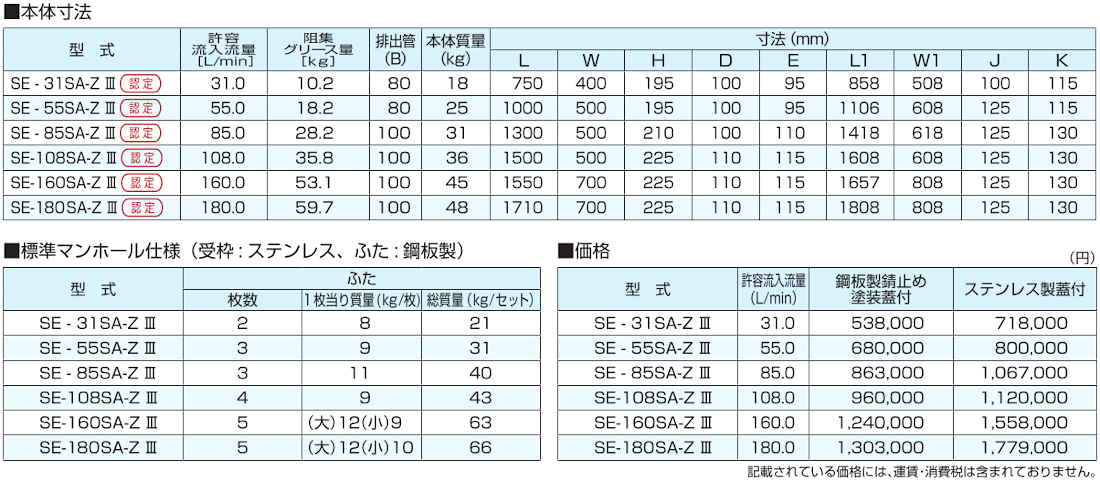

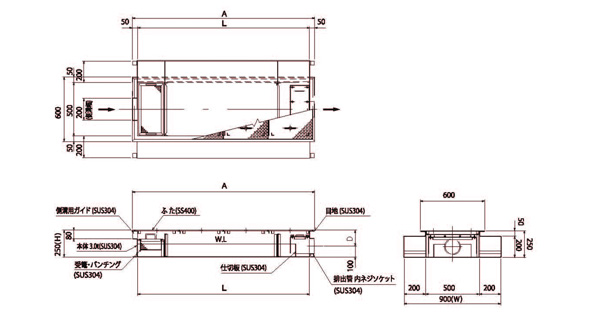

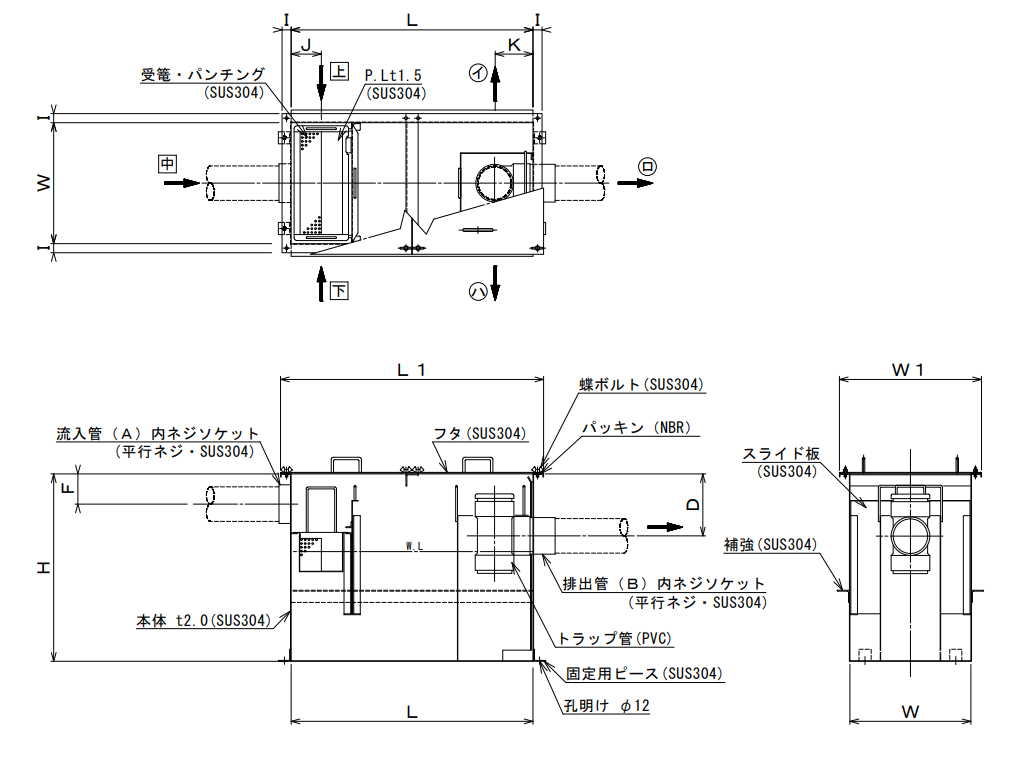

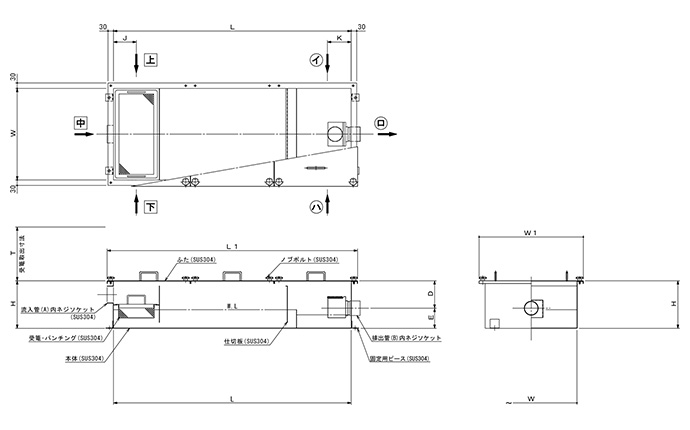

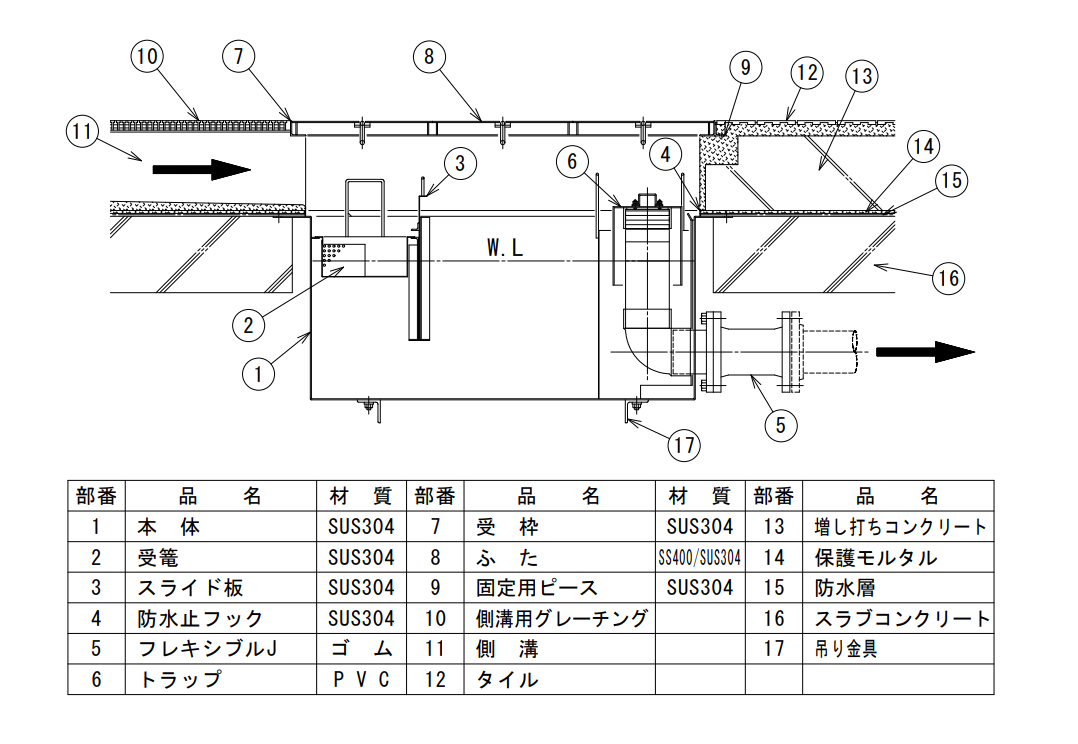

SE式 ステンレス製浅型 グリーストラップ

722304円下田エコテック SE-336SA-ZDBI ステンレス製蓋付DIY、工具業務、産業用グリーストラップ ステンレス製 床置型 パイプ導入型

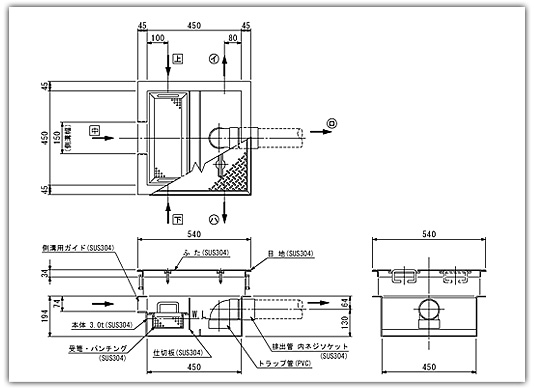

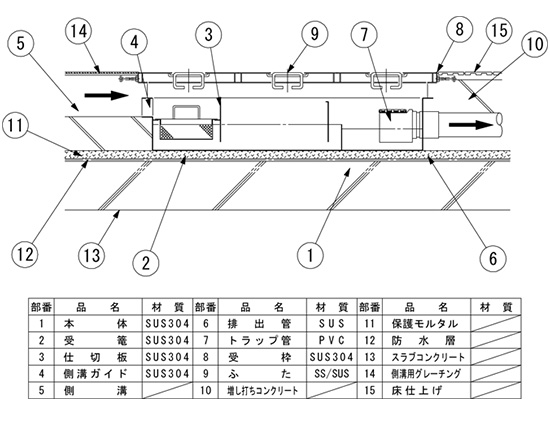

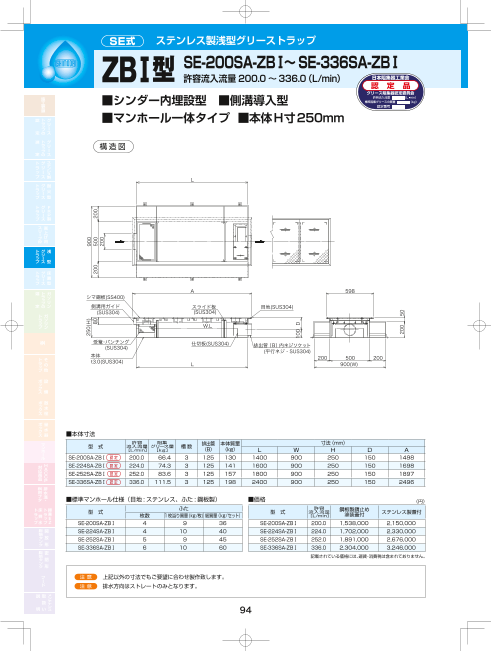

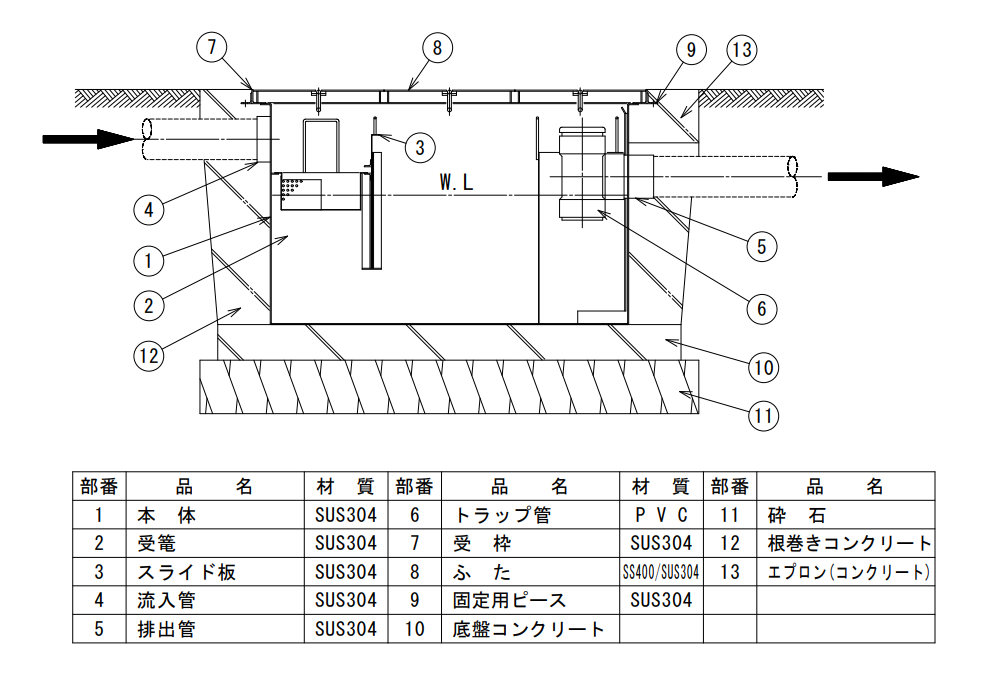

ZDBI型(シンダー内埋設・パイプ導入型・マンホール一体タイプ・本体H寸330mm)

SE-200SA-ZDBI〜SE-336SA-ZDBI

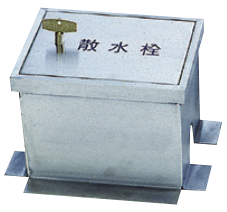

鋼板製錆止め塗装蓋付

ステンレス製蓋付

サイズ仕様等は下田エコテック公式HPにて

確認をお願いいたします。

下田エコテックHP

http://www.shimoda-ecotech.co.jp/

ZDBI型カタログのページ

http://www.shimoda-ecotech.co.jp/files/catalogue_p080.pdf

受注生産品にてキャンセル一切できませんので

予めご了承ください。

受注生産品にて納期2週間程度かかります。下田エコテック SE-336SA-ZDBI ステンレス製蓋付 : 845502961

楽天市場】SE-85SA-ZIII ステンレス製蓋付 下田エコテック SE式

楽天市場】下田エコテック FRP製浅型 グリーストラップ SK30SC-RZDLIII

SE50NS-RD ステンレス製蓋付 下田エコテック NS式 FRP製グリーストラップ RD型 地中埋設 パイプ導入型 : se50ns-rd-s : アクアshop - 通販 - Yahoo!ショッピング

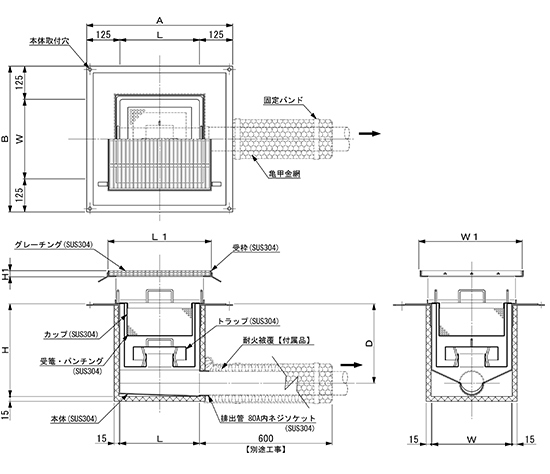

SE式 ステンレス製 グリーストラップ D型(地中埋設・パイプ導入型

下田エコテック ステンレス製グリーストラップ シンダー内埋設型 浅型

下田エコテック FRP製浅型 グリーストラップ SE-35SA-RZI 鋼板製錆止め

グリーストラップ ステンレス製 増し打ちコンクリート内埋設型(浅型

楽天市場】SE-85SA-ZIII ステンレス製蓋付 下田エコテック SE式

グリーストラップ ステンレス製 増し打ちコンクリート内埋設型(浅型

楽天市場】下田エコテック FRP製浅型 グリーストラップ SK30SC-RZDLI

下田エコテック ステンレス製グリーストラップ シンダー内埋設型 浅型

下田エコテック ステンレス製グリーストラップ シンダー内埋設型 浅型

楽天市場】SE-85SA-ZIII ステンレス製蓋付 下田エコテック SE式

SE-37S-RDV ステンレス製蓋付 下田エコテック SE式 FRP製グリーストラップ S-RDV型 地中埋設 パイプ導入型

グリーストラップ ステンレス製 地中埋設型 パイプ導入型

SE-55SA-ZIII ステンレス製蓋付 下田エコテック SE式 ステンレス製浅型

グリーストラップ ステンレス製 増し打ちコンクリート内埋設型(浅型

グリーストラップ(下田エコテック) - KATOテンポ厨房設備ネット

楽天市場】下田エコテック ステンレス製浅型厨房用トラップ桝 18SZN I

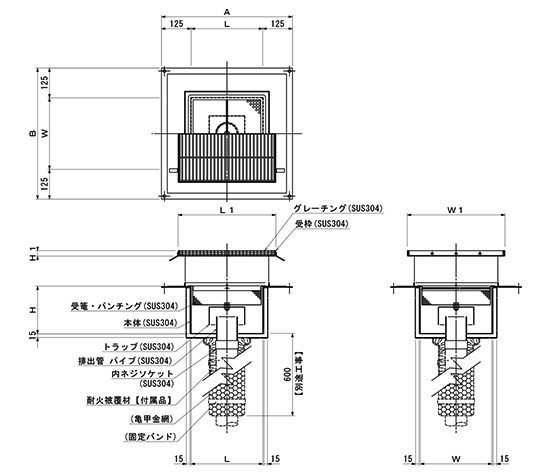

ダスタートラップ ステンレス製 スラブ天吊・耐火型

SE-55SA-ZIII ステンレス製蓋付 下田エコテック SE式 ステンレス製浅型

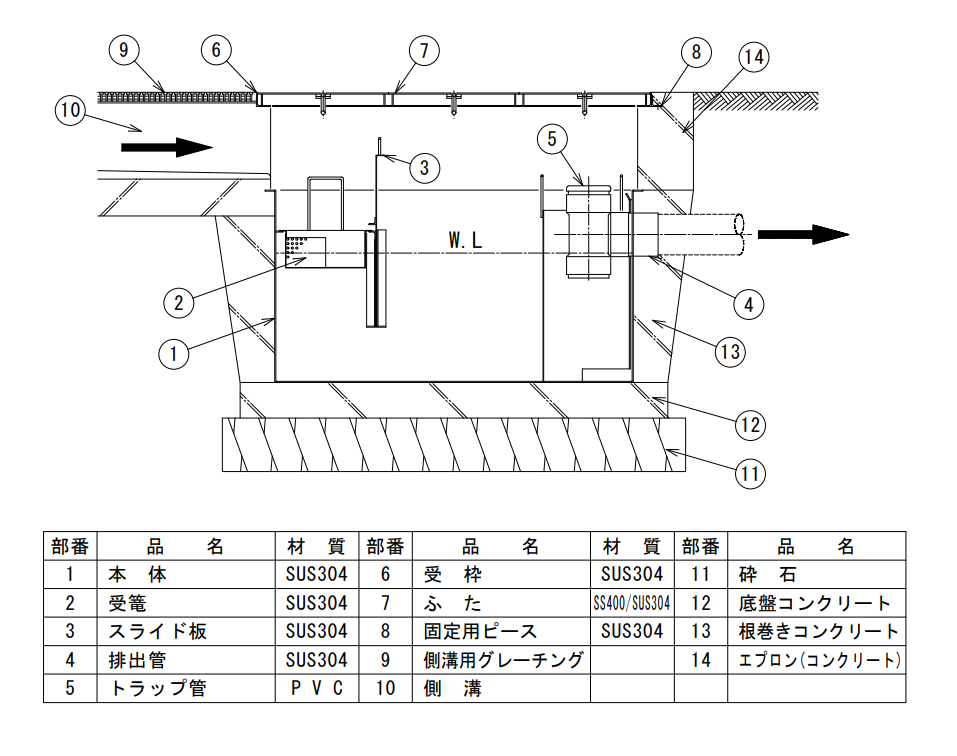

グリーストラップ ステンレス製 地中埋設型 側溝導入型

グリーストラップ ステンレス製 床置型 パイプ導入型

下田エコテック FRP製浅型 グリーストラップ SK22SC-RZDLI 鋼板蓋付き(ステンレス蓋オプション可)

グリーストラップ ステンレス製 床置型 パイプ導入型

下田エコテック - アナハイム 厨房設備ネット販売事業部 インボイス

ダスタートラップ ステンレス製 スラブ天吊・耐火型

楽天市場】SE-85SA-ZIII ステンレス製蓋付 下田エコテック SE式

グリーストラップ ステンレス製 スラブ天吊型 側溝導入型

グリーストラップ ステンレス製 地中埋設型 パイプ導入型

楽天市場】SE-85SA-ZIII ステンレス製蓋付 下田エコテック SE式

SK式各種ボックス|グリーストラップ・各種阻集器・排水処理機器

下田エコテック株式会社

楽天市場】SE-85SA-ZIII ステンレス製蓋付 下田エコテック SE式

下田エコテック JIA-U-800T-SE 鋼板製錆止め塗装蓋付(枠SUS304 / 蓋

g37300]【幅22cm】New work style 360°セラミックヒーター 加湿器

KaguBuy EKO ゴミ箱 自動開閉 20L+20L ステンレス ふた付き おしゃれ

KaguBuy EKO ゴミ箱 自動開閉 20L+20L ステンレス ふた付き おしゃれ

下田エコテック SE-381SA-RD T-20-

商品の情報

メルカリ安心への取り組み

お金は事務局に支払われ、評価後に振り込まれます

出品者

スピード発送

この出品者は平均24時間以内に発送しています

![g37300]【幅22cm】New work style 360°セラミックヒーター 加湿器](https://d277jmppmje79i.cloudfront.net/uimg/g37300-l.jpg)