河村電器産業 ONF337K 種別 標準制御盤ポンプ制御盤 ONF3

(税込) 送料込み

商品の説明

商品情報

メーカー(河村電器産業)より直送便にてお届けとなります。

26172円河村電器産業 ONF337K 種別 標準制御盤ポンプ制御盤 ONF3DIY、工具材料、部品Yahoo!オークション -「ポンプ 制御盤」(住まい、インテリア) の落札

メーカー在庫品は2〜3営業日以内の出荷となります。

欠品時は納期を別途御案内させていただきます。ONF337K ポンプ制御盤 F3 1個 河村電器産業 【通販サイトMonotaRO】

NF337K ポンプ制御盤 F3 1個 河村電器産業 【通販サイトMonotaRO】

河村電器産業 G437AK 種別 標準制御盤ポンプ制御盤 G4-A-

Yahoo!オークション -「ポンプ制御盤」の落札相場・落札価格

Yahoo!オークション -「ポンプ制御盤」の落札相場・落札価格

Yahoo!オークション -「ポンプ制御盤」の落札相場・落札価格

Yahoo!オークション -「ポンプ制御盤」の落札相場・落札価格

Yahoo!オークション -「ポンプ制御盤」の落札相場・落札価格

河村電器産業 G437A 種別 標準制御盤ポンプ制御盤 G4-A-

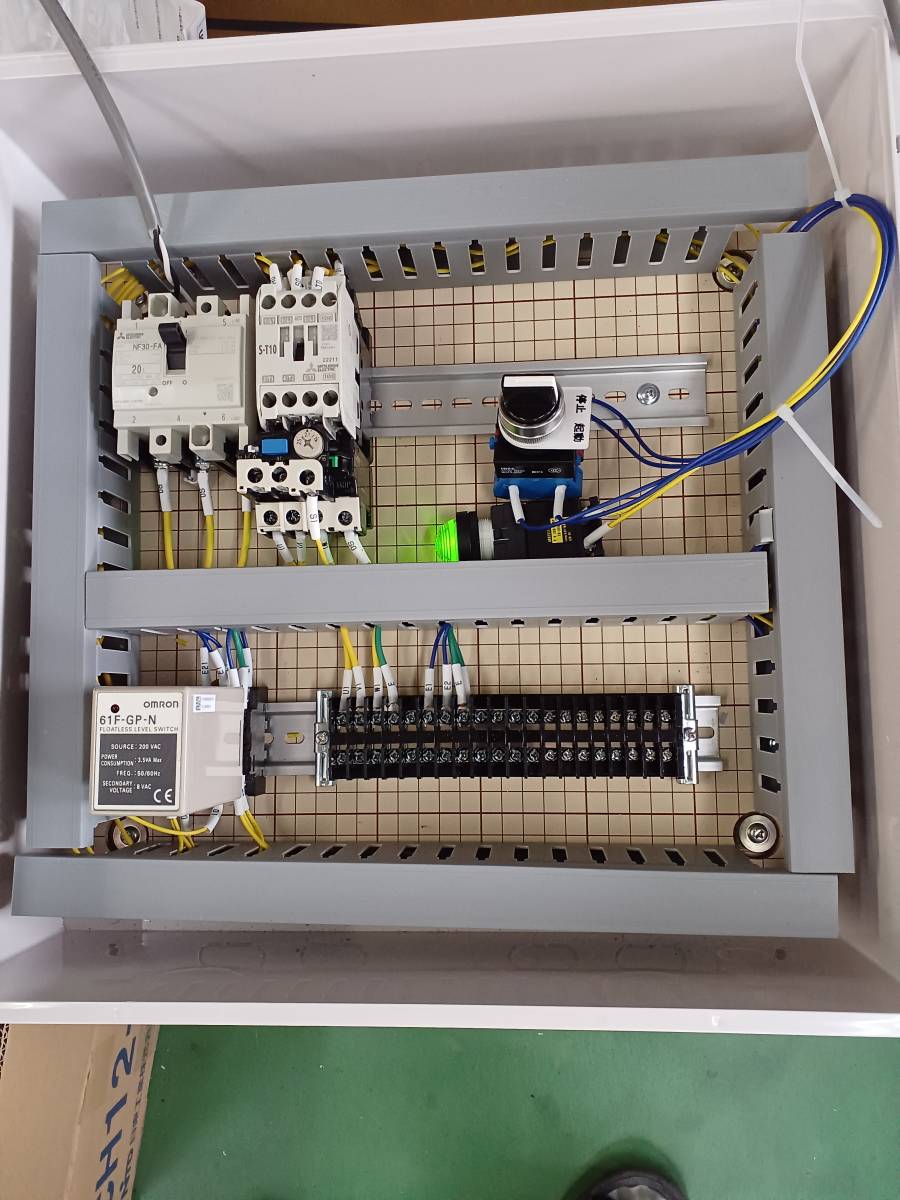

河村電器産業 G237DK ポンプ制御盤 自動交互同時運転 モーターブレーカ-

Yahoo!オークション -「ポンプ 制御盤」(住まい、インテリア) の落札

Yahoo!オークション -「ポンプ制御盤」の落札相場・落札価格

河村電器産業 OEF3075 種別 標準制御盤ポンプ制御盤 OEF3-

工場直送 河村電器産業 EQF31034WNK コンポ盤 - 材料、部品

河村電器産業株式会社 | 製品情報 | 製品カタログ

河村電器産業 OEF3075 種別 標準制御盤ポンプ制御盤 OEF3-

河村電器産業 G437A 種別 標準制御盤ポンプ制御盤 G4-A-

Yahoo!オークション -「ポンプ 制御盤」(住まい、インテリア) の落札

Yahoo!オークション -「ポンプ制御盤」の落札相場・落札価格

Yahoo!オークション -「ポンプ制御盤」の落札相場・落札価格

河村電器産業 OF304A 種別 標準制御盤ポンプ制御盤 OF3-A-

Yahoo!オークション -「ポンプ制御盤」の落札相場・落札価格

河村電器産業 G437A 種別 標準制御盤ポンプ制御盤 G4-A-

河村電器産業 G437A 種別 標準制御盤ポンプ制御盤 G4-A-

Yahoo!オークション -「ポンプ制御盤」の落札相場・落札価格

Yahoo!オークション -「ポンプ 制御盤」(住まい、インテリア) の落札

河村電器産業 G437AK 種別 標準制御盤ポンプ制御盤 G4-A-

Yahoo!オークション -「ポンプ制御盤」の落札相場・落札価格

河村電器産業 G237DK ポンプ制御盤 自動交互同時運転 モーターブレーカ-

Yahoo!オークション -「ポンプ制御盤」の落札相場・落札価格

Yahoo!オークション -「ポンプ 制御盤」(住まい、インテリア) の落札

河村電器産業 G437AK 種別 標準制御盤ポンプ制御盤 G4-A-

河村電器産業 OEF3075 種別 標準制御盤ポンプ制御盤 OEF3-

Yahoo!オークション -「ポンプ 制御盤」(住まい、インテリア) の落札

Yahoo!オークション -「ポンプ 制御盤」(住まい、インテリア) の落札

河村電器産業 G237DK ポンプ制御盤 自動交互同時運転 モーターブレーカ-

Yahoo!オークション -「ポンプ 制御盤」(住まい、インテリア) の落札

河村電器産業 OF304A 種別 標準制御盤ポンプ制御盤 OF3-A-

河村電器産業 G237D ポンプ制御盤 自動交互同時運転 モーターブレーカ-

Yahoo!オークション -「ポンプ 制御盤」(住まい、インテリア) の落札

商品の情報

メルカリ安心への取り組み

お金は事務局に支払われ、評価後に振り込まれます

出品者

スピード発送

この出品者は平均24時間以内に発送しています